Инновации

Разрабатываем инновационные продукты для российского рынка

качество

Придерживаемся наивысших стандартов качества

компетенции

Обладаем большим опытом в создании современных ИТ- решений

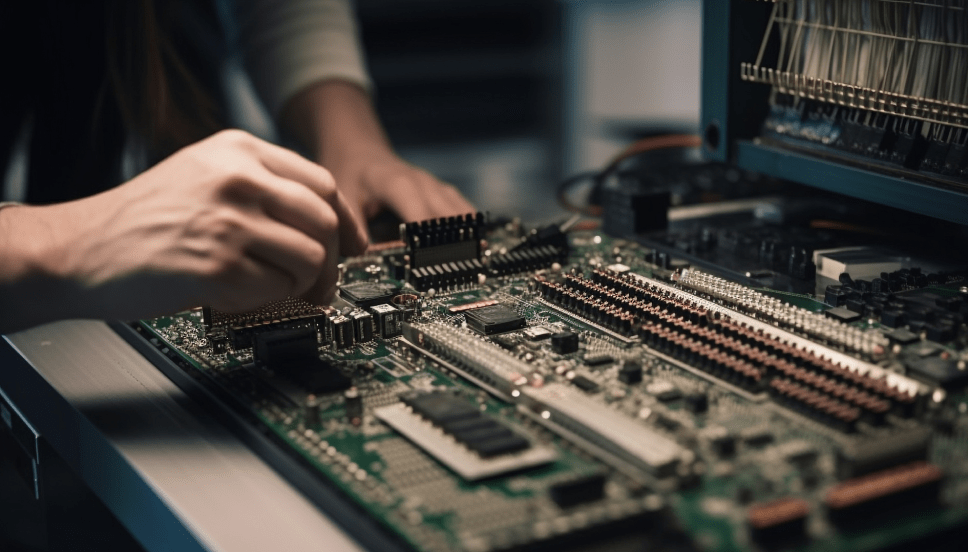

О компании

Delta Solutions — российский разработчик электроники. Мы создаем аппаратные решения для российского ИТ-рынка более 15 лет. Наша компания объединяет конструкторов, схемотехников, топологов: наших сотрудников — инженеры.

Собственный центр разработки

Инновационное проектирование

Запуск и отладка проектируемого оборудования

Подготовка в массовому производству

Разработка электрического и функционального контроля

Постановка на производство

Мы создаем

Аппаратное обеспечение

Комплексные аппаратные решения

- Серверные платформы

- Модули хранения и расширения

- Коммутационное оборудование

- Прочие составляющие ИТ-инфраструктуры

Механический дизайн

- Проектирование конструктивов

- Проектирование пресс-форм

- Проектирование штампов

Разработка схемотехники и топологии печатных плат

Программное обеспечение

Микропрограммное обеспечение

- BIOS

- FPGA

- ВМС

- ПО для микроконтроллеров

Программное обеспечение

- ПО для управления и мониторинга

- инфраструктуры ЦОД

- ПО для управления и мониторинга

- клиентским оборудованием

Контакты

Юридический адрес :

140002, Московская область, г. о. Люберцы, г. Люберцы, ул. Колхозная, д. 8А

Телефон :

+ 7 (495) 6О7-14-41